Música

Suno, Udio e a batalha pelo direito de criar música com IA

A música com inteligência artificial passou muito rápido da fase “olha que bizarro esse Drake falso” para a fase “chama o jurídico, chama o investidor e chama o departamento de licenciamento”. O que até pouco tempo parecia um brinquedo de meme, uma curiosidade para viralizar no TikTok ou um delírio tecnófilo de artista futurista, virou um dos centros nervosos da indústria musical.

Hoje, plataformas como Suno e Udio conseguem gerar faixas completas em poucos minutos, com voz, letra, arranjo, mixagem e estética de gênero. Ao mesmo tempo, gravadoras como Universal, Sony e Warner processam, negociam, fazem acordos e tentam transformar o caos em contrato. Segundo a Pitchfork, a música por IA já não é um fenômeno marginal: ela entrou nas paradas, nos acordos de licenciamento, nas disputas de copyright e nos planos estratégicos das majors.

A treta central é simples de entender e difícil de resolver: essas plataformas são ferramentas criativas legítimas ou máquinas treinadas em cima de catálogos protegidos sem autorização? Em junho de 2024, a RIAA anunciou processos contra Suno e Udio, acusando as empresas de uso massivo de gravações protegidas por direitos autorais para treinar sistemas de geração musical.

Desde então, a guerra saiu do campo puramente judicial e entrou no campo do “vamos negociar antes que alguém perca tudo”. Universal e Udio chegaram a um acordo em 2025 para desenvolver uma plataforma licenciada de criação musical com IA. Warner também fechou acordos com Udio e Suno, resolvendo litígios e preparando modelos licenciados para 2026.

Ou seja: a velha indústria não está apenas tentando matar a IA musical. Está tentando domesticá-la, colocar coleira, cobrar pedágio e transformar cada prompt em nova linha de receita.

Suno: a estrela pop da IA musical

A Suno é hoje a empresa mais visível desse novo ecossistema. Lançada publicamente em dezembro de 2023, a plataforma popularizou a promessa direta: criar qualquer música que você imaginar. O usuário digita um prompt, escolhe estilos, ajusta parâmetros e recebe uma faixa com vocal, letra, instrumentação e estrutura pop pronta para circular.

A Pitchfork destaca que a Suno afirma gerar cerca de 7 milhões de músicas por dia, um número que ajuda a explicar tanto o fascínio quanto o pânico da indústria. Porque, se a música vira uma torneira infinita, a pergunta deixa de ser apenas “quem cria?” e passa a ser “quem filtra, quem monetiza e quem paga a conta dos direitos?”.

A empresa foi processada por gravadoras, mas o cenário começou a mudar quando a Warner Music Group fechou um acordo com a plataforma. Pelo anúncio da própria Warner, a parceria prevê novos modelos licenciados em 2026, substituição dos modelos atuais e restrições para downloads, especialmente em músicas criadas na camada gratuita.

A Reuters também informou que o acordo resolveu o processo da Warner contra a Suno e abriu caminho para modelos licenciados, enquanto Universal e Sony continuavam em litígio contra a empresa. Aqui está o ponto quente: a Suno virou grande demais para ser ignorada, mas ainda polêmica demais para ser plenamente absorvida pela indústria tradicional.

Udio: da explosão viral ao jardim murado

A Udio surgiu em abril de 2024 com credenciais de peso: ex-pesquisadores do Google DeepMind e apoio de investidores como a Andreessen Horowitz. Assim como a Suno, vende a ideia de música completa gerada por prompt. Mas sua trajetória recente mostra um movimento diferente: sair da internet aberta e caminhar para um modelo mais controlado, licenciado e fechado.

A plataforma ficou conhecida também por ter sido usada na criação de “BBL Drizzy”, faixa viral associada ao universo das diss tracks e da cultura remix. Mas a fama veio junto com processo. Udio e Suno foram alvo das ações das majors em 2024.

Em 2025, a Universal anunciou acordo com a Udio para criar uma nova plataforma licenciada de música com IA. A AP noticiou que, após o acordo, a Udio deixou de oferecer downloads de músicas geradas por IA, provocando reação negativa de usuários. A Warner também anunciou acordo semelhante com a Udio, estabelecendo uma estrutura para um serviço licenciado de criação musical com lançamento previsto para 2026.

Na prática, a Udio virou símbolo de uma tendência: a IA musical pode até nascer como ferramenta aberta, mas as majors preferem que ela viva dentro de um cercadinho bem iluminado, com controle de uso, licenciamento e dinheiro voltando para os donos dos catálogos.

Boomy: democratização, ruído e o fantasma da fraude

A Boomy é anterior à explosão Suno/Udio. Lançada em 2021, ela se posicionou como uma ferramenta para pessoas sem experiência musical criarem faixas rapidamente, com controles de gênero, andamento, instrumentos, mixagem e voz.

O problema é que a Boomy acabou associada a uma das histórias mais espinhosas da nova música automatizada: o caso Michael Smith. O Departamento de Justiça dos EUA acusou Smith de usar músicas geradas com IA e bots para fraudar plataformas de streaming e obter milhões de dólares em royalties.

Em março de 2026, o Guardian noticiou que Smith se declarou culpado de conspiração para cometer fraude eletrônica, em um esquema que teria usado músicas geradas por IA e audições automatizadas para desviar mais de US$ 10 milhões em royalties.

Esse caso é importante porque mostra o lado mais podre do “conteúdo infinito”: se qualquer um pode gerar milhares de faixas, criar artistas falsos e simular audiência, o streaming vira um cassino de robôs. E, nesse cassino, quem perde primeiro é o artista humano que já recebia pouco.

ElevenLabs: quando a voz vira território de guerra

A ElevenLabs ficou mais conhecida por ferramentas de voz sintética, clonagem vocal e dublagem com IA. No universo musical, isso toca num nervo exposto: a voz é identidade, marca, presença, corpo, assinatura emocional. Clonar uma voz não é a mesma coisa que gerar uma batida genérica.

Segundo a Pitchfork, a ElevenLabs ainda não fechou grandes acordos com gravadoras, mas já se aproximou do campo musical por meio de projetos envolvendo vozes sintéticas e figuras reconhecíveis. A empresa também enfrentou processo movido por dubladores e autores, que alegaram uso indevido de vozes a partir de audiolivros protegidos.

No fundo, a ElevenLabs representa uma camada específica da revolução: não é apenas “fazer música com IA”, mas manipular presença vocal. E isso é dinamite jurídica, artística e emocional.

Klay Vision: a startup misteriosa que agradou as majors

A Klay Vision é um caso curioso. Ainda sem um produto amplamente consolidado no mercado, a empresa ganhou atenção por buscar um caminho mais diplomático: licenciamento antes da guerra total.

A Pitchfork descreve a Klay como uma startup com pouco produto público, mas muito discurso de mercado, incluindo ambições de criar uma plataforma de streaming e uma rede social musical. O ponto mais relevante é que a empresa aparece associada a acordos com as três grandes gravadoras e suas editoras, um diferencial enorme num setor em que outras startups começaram sendo processadas.

É o modelo “não peça desculpas depois, peça licença antes”. Pode ser menos punk, menos viral e menos sexy para o usuário final, mas é exatamente o tipo de estratégia que costuma deixar advogado de major dormindo melhor.

Splice: IA para produtor, não para turista de prompt

A Splice já era relevante antes da febre generativa. Sua biblioteca de samples royalty-free virou parte do fluxo de trabalho de produtores de pop, eletrônica, hip-hop e música comercial. A diferença é que a IA, no caso da Splice, entra menos como “aperte um botão e receba uma música” e mais como ferramenta para encontrar, recombinar e transformar sons.

A própria Splice afirma que começou sua trajetória de IA voltada a criadores em 2019 com o Similar Sounds, ferramenta que usa machine learning para encontrar sons parecidos no catálogo. Em 2026, a empresa anunciou novas ferramentas de IA voltadas à compensação de criadores de samples quando seus sons são usados como fonte ou variação.

Esse é um caminho importante porque muda o enquadramento: em vez de substituir o produtor por um prompt, a IA vira uma extensão do estúdio. Menos “robô compositor” e mais “assistente de produção turbinado”.

Loudly e Soundraw: música funcional, royalty-free e mercado de fundo

Nem toda música com IA quer disputar o Grammy, imitar Drake ou ressuscitar Freddie Mercury em versão deepfake. Plataformas como Loudly e Soundraw miram um mercado gigantesco e menos glamouroso: trilhas, música de fundo, vídeos corporativos, redes sociais, games, publicidade barata, conteúdo de creator e sonorização sob demanda.

A Pitchfork aponta que a Loudly oferece geração por prompt, remix, compatibilidade com DAWs e distribuição, enquanto a Soundraw se posiciona como solução para música de fundo royalty-free, com material criado internamente.

Esse é talvez o setor mais silenciosamente ameaçador para compositores de biblioteca, produtores de trilha branca e músicos que vivem de sync pequeno. A IA pode não matar o artista pop, mas pode esmagar o mercado intermediário de música funcional — aquele jingle, aquela trilha de vídeo institucional, aquele loop de fundo que pagava o aluguel de muita gente.

Music Flamingo e a IA que não compõe: analisa

Outro ramo da corrida não é a geração, mas a análise musical. A Pitchfork cita o Music Flamingo, ligado à Nvidia, como uma plataforma voltada à compreensão de estrutura, instrumentação, letra e contexto cultural da música.

Esse tipo de IA não entra necessariamente para criar canções, mas para organizar, recomendar, classificar e extrair sentido de catálogos gigantescos. É uma camada menos visível para o público, mas altamente estratégica para gravadoras, plataformas de streaming e empresas que querem transformar gosto musical em dado acionável.

Aqui mora uma das partes mais assustadoras — e lucrativas — da história: a IA não precisa compor a próxima música para controlar o mercado. Ela pode simplesmente decidir qual música será descoberta.

A grande virada: de processo para licenciamento

O que está acontecendo agora é uma migração do conflito bruto para o contrato. Em 2024, as majors bateram forte em Suno e Udio. Em 2025 e 2026, começaram a aparecer acordos, modelos licenciados, plataformas fechadas, opt-in de artistas, controle de voz, nome, imagem e composição.

Isso não significa paz. Significa que a indústria percebeu que a IA musical não vai desaparecer. O novo jogo é decidir quem fica com o dinheiro quando a máquina canta.

Para os artistas, o cenário é ambíguo. Há oportunidades reais: novas ferramentas de composição, produção barata, experimentação estética, prototipagem rápida e distribuição criativa. Mas há também riscos brutais: diluição de mercado, clonagem de estilo, contratos abusivos, perda de controle sobre voz e imagem, além de um oceano de conteúdo sintético empurrando o valor médio da música ainda mais para baixo.

Para as gravadoras, a IA é ameaça e salvação ao mesmo tempo. Ela pode corroer o valor dos catálogos, mas também pode gerar novas receitas se for licenciada, cercada e convertida em produto corporativo.

Para startups, o recado é claro: crescer rápido demais sem acordo pode virar processo. Pedir licença cedo demais pode matar a cultura de usuário. O equilíbrio entre revolução e submissão ao velho mercado será a linha fina dessa década.

O que isso significa para a MVAI

Para a MVAI, a leitura é direta: a música com IA já entrou na fase industrial. Não estamos mais falando só de curiosidade tecnológica. Estamos falando de cadeia produtiva, catálogo, vídeo, artista virtual, licenciamento, distribuição, branding, publicidade, sync, comunidades e monetização.

A oportunidade não está apenas em gerar música. Isso qualquer ferramenta fará cada vez melhor. A oportunidade está em criar linguagem, narrativa, personagem, videoclipe, comunidade, estética, curadoria e modelo de negócio.

A nova indústria musical será menos parecida com uma gravadora tradicional e mais parecida com uma mistura de estúdio audiovisual, laboratório de IA, agência de publicidade, selo musical, canal de mídia e fábrica de propriedade intelectual.

Suno e Udio abriram a porteira. As majors tentam colocar cerca. Mas o território ainda está em disputa.

E, como sempre acontece quando uma tecnologia nova bagunça o coreto, quem entender antes que a música agora é software, mídia e personagem ao mesmo tempo vai sair na frente. Quem achar que é só “apertar um botão e fazer musiquinha” vai virar figurante no próprio futuro.

Fonte: Pitchfork

Tecnologia & IA

Google Flow Music tenta enfrentar a Suno, mas chega atrasado à revolução da música com IA

Entre Lyria 3, Veo, Flow, Gemini e uma aposta bilionária na Anthropic, o Google parece finalmente ter entendido que a revolução da música com IA não é um “recurso experimental”. É uma nova indústria. O problema: a Suno entendeu isso antes.

O Google acaba de colocar mais uma peça no seu tabuleiro de inteligência artificial criativa: o chamado Google Flow Music, uma plataforma que promete funcionar como um estúdio all-in-one para criar músicas, remixar faixas, gerar clipes com IA, editar trechos, separar stems, publicar criações e até “vibe-codear” instrumentos, plugins, jogos musicais e DAWs customizadas. No papel, parece o tipo de ferramenta que um império tecnológico com dinheiro infinito deveria lançar. Na prática, o cheiro é outro: o de uma gigante correndo atrás de uma cena que explodiu sem pedir licença — e onde a Suno já virou linguagem, ferramenta, comunidade e cultura.

Segundo a própria página pública do Flow Music, a plataforma permite conversar com um agente chamado Producer, criar canções “full-length” com vocal dinâmico usando Lyria 3, dirigir videoclipes com o modelo Veo, remixar áudio, aplicar efeitos, dividir stems e criar ferramentas musicais dentro de espaços próprios. A proposta é bonita: um estúdio IA de bolso. Só que a execução, pelo menos nesse primeiro impacto, parece aquele velho Google pós-2010: tecnicamente poderoso, conceitualmente atrasado, emocionalmente frio e com cara de produto feito por comitê.

A comparação inevitável é com a Suno, e é aí que a coisa pega fogo.

O Google descobriu a música com IA depois que a pista já estava lotada

A Suno não é apenas uma ferramenta de geração musical. Ela virou, para muita gente, o primeiro contato real com a ideia de que uma pessoa sem banda, sem estúdio, sem produtor e sem gravadora pode criar uma música com letra, voz, melodia, arranjo e estrutura em minutos. A própria Wikipedia define a Suno como uma plataforma de IA generativa voltada à criação musical, capaz de gerar música com vocais e instrumentação a partir de prompts de texto ou áudio. A plataforma está amplamente disponível desde dezembro de 2023 e chegou a ser integrada ao Microsoft Copilot.

Isso é importante porque a Suno não chegou como “feature”. Ela chegou como instrumento cultural.

O Google, por outro lado, vem empilhando nomes: MusicLM, MusicFX, Music AI Sandbox, Lyria, Gemini, Flow, Veo, agora Flow Music. É IA criativa em modo gaveta corporativa. Cada gaveta tem uma plaquinha bonita, uma página institucional elegante, um vídeo de demonstração impecável — e pouca sensação de que há ali uma comunidade musical viva, suando, errando, criando atrocidades maravilhosas às três da manhã.

A Suno tem defeitos? Tem. Tem polêmica jurídica? Tem. Tem som plastificado em várias gerações? Tem também. Mas ela tem uma coisa que o Google raramente consegue fabricar: tesão de uso.

O que é o Flow Music?

O Flow Music aparece como uma plataforma de criação musical com IA que mistura geração de faixas, remixagem, edição, publicação e criação de videoclipes. A página do serviço fala em músicas completas com “musicalidade rica” e vocais dinâmicos, usando o modelo Lyria 3. Também promete usar o Veo para transformar músicas em videoclipes, dando ao usuário controle sobre personagens, estética e detalhes visuais.

Além disso, a documentação pública do Flow Music apresenta o Producer como uma espécie de parceiro de estúdio, um agente com quem o usuário conversa para produzir música.

Reportagens recentes no Brasil também descreveram o Flow Music como uma evolução ou rebatismo de um produto chamado ProducerAI, com funções de geração por prompt, recursos sociais e ferramentas como vibe-code para plugins, jogos musicais e DAWs personalizadas. O Canaltech, por exemplo, descreveu o acesso via navegador, com comando de texto no campo “Ask producer”.

A proposta, portanto, é clara: não é só gerar música. É criar um ambiente completo para composição, edição, remixagem, publicação e audiovisual. Em tese, o Google quer juntar o que hoje está espalhado entre Suno, Udio, DAWs, Runway, Luma, Kling, CapCut, plugins de áudio e plataformas sociais.

Bonito. Ambicioso. Mas também perigosamente “Google demais”.

O problema: o Google ainda parece pensar como engenheiro, não como músico

O Google tem modelos fortíssimos. O Lyria 3, integrado ao Gemini, já permite criar músicas por texto ou imagem. A página oficial do Gemini informa que o Lyria 3 gratuito cria faixas de até 30 segundos, enquanto o Lyria 3 Pro pode gerar músicas de até 3 minutos em planos pagos do Google AI Plus, Pro e Ultra.

Em fevereiro de 2026, o Google anunciou oficialmente que o Gemini passaria a criar músicas com o Lyria 3 em beta, com faixas de 30 segundos, capa gerada por IA e marca d’água SynthID para identificação de áudio criado por IA.

Ou seja: tecnologia existe. Modelo existe. Infraestrutura existe. O problema é outro.

Música não é só fidelidade. Música é acidente, sujeira, decisão errada que vira estética, refrão que gruda, timbre que machuca, grave que entra no peito, vocal imperfeito que parece humano porque quase cai do trilho. A Suno, com todos os seus vícios, entendeu isso melhor que o Google. Ela vende uma sensação: “eu fiz uma música”. O Google vende uma arquitetura.

E arquitetura, meu querido, não dança.

Suno: a máquina que virou brinquedo sério

A Suno vem evoluindo numa velocidade que explica o desespero tardio do Google. Em março de 2026, a empresa lançou a Suno v5.5, com foco em identidade musical, incluindo Voices, Custom Models e My Taste. A própria Suno descreve a v5.5 como seu modelo “mais expressivo”, com recursos para capturar voz, treinar modelos personalizados e adaptar gerações ao gosto do usuário.

A Suno também se vende como um ambiente completo para criação musical. Em material próprio atualizado em 2026, a empresa afirma que permite criar músicas, letras, beats, vocais e edições em um só lugar, além de destacar o Suno Studio como uma DAW nativa de IA, com edição em timeline, camadas, exportação MIDI e geração instantânea de vocais, bateria e sintetizadores.

Isso muda o jogo.

A briga não é mais “quem gera uma música engraçadinha por prompt”. A briga agora é: quem vira o Pro Tools da geração IA? Quem vira o Logic da garotada sintética? Quem vira o Ableton de uma geração que compõe conversando com modelo?

A Suno está tentando ocupar esse lugar por dentro da cultura musical. O Google está tentando ocupar por cima, pela força da infraestrutura.

O Veo é o que salva a operação

Se tem uma parte realmente forte na aposta do Google, ela se chama Veo.

O Flow, lançado pelo Google em maio de 2025, foi apresentado como uma ferramenta de produção cinematográfica com IA construída especialmente para os modelos Veo, Imagen e Gemini. O Google descreveu o Flow como um ambiente para criadores explorarem ideias, criarem cenas e clipes cinematográficos, com o Gemini ajudando na interpretação de prompts e o Veo entregando vídeo com física, realismo e aderência ao comando.

O próprio Google DeepMind afirma que o Veo 3 permite adicionar efeitos sonoros, ruído ambiente e diálogo gerados nativamente, além de entregar qualidade de vídeo com forte aderência ao prompt, realismo e física.

Aqui, sim, o Google tem uma carta pesada.

Para a MVAI, que pensa música, videoclipe e audiovisual como uma mesma cadeia criativa, o Veo é a parte realmente estratégica. Se o Flow Music conseguir costurar música e vídeo de forma orgânica, sem parecer uma gambiarra de produtos colados com fita dupla face, pode virar uma ferramenta relevante para videoclipes IA.

Mas esse é justamente o “se” gigante.

Porque música com IA sem cultura vira jingle de banco. Videoclipe com IA sem direção vira demo de benchmark. E plataforma all-in-one sem comunidade vira cemitério de produto Google.

Alô, Google Stadia. Alô, Google+. Alô, toda a ala de defuntos brilhantes do Google.

O Flow Music quer ser Suno, Runway, Ableton e YouTube ao mesmo tempo

O Flow Music parece nascer com uma ambição quase imperial: ser gerador musical, editor, remixador, rede social, estúdio de vídeo e ambiente de criação de ferramentas. Isso é, ao mesmo tempo, fascinante e suspeito.

Fascinante porque, se funcionar, pode encurtar drasticamente o caminho entre ideia, música, videoclipe e distribuição.

Suspeito porque o Google tem uma longa tradição de lançar produtos com nome bonito, matar produtos com frieza soviética e deixar criadores com cara de trouxa no acostamento.

Artista precisa confiar na ferramenta. Precisa acreditar que o projeto não vai desaparecer porque algum executivo achou que “não bateu OKR”. A Suno, por ser uma empresa nascida dentro do problema musical, parece ter mais clareza de missão. O Google parece ter mais capacidade computacional, mas menos alma.

E na música, alma ainda conta. Mesmo quando é alma sintética.

E os US$ 40 bilhões na Anthropic?

No mesmo tabuleiro, o Google também aparece aprofundando sua aposta na Anthropic. Segundo a Reuters, a Alphabet deve investir até US$ 40 bilhões na empresa criadora do Claude: US$ 10 bilhões em dinheiro agora, avaliando a Anthropic em US$ 350 bilhões, e mais US$ 30 bilhões condicionados a metas de performance.

A notícia é brutal porque mostra uma coisa: mesmo o Google, com DeepMind, Gemini, TPU, YouTube, Android, Search e dinheiro infinito, está comprando posição em concorrente. É o tipo de movimento que grita: “temos tudo, menos tranquilidade”.

E aí fica a pergunta: se o Google precisa colocar dezenas de bilhões na Anthropic para não perder o bonde dos modelos gerais, que confiança o mercado deve ter em mais uma plataforma criativa do Google tentando correr atrás da Suno?

É claro: Anthropic não é “plataforma duvidosa” no sentido técnico. Claude é forte, especialmente em código. A própria Reuters relata que o Claude Code ganhou tração entre desenvolvedores e que a receita anualizada da Anthropic ultrapassou US$ 30 bilhões em abril de 2026.

Mas estrategicamente, para o Google, a cena é esquisita: a empresa que prometia organizar a informação do mundo agora parece tentando organizar o próprio pânico.

Suno também tem telhado de vidro — mas está no lugar certo da revolução

Ser Team Suno não significa fingir que a Suno é santa. A plataforma foi processada por grandes gravadoras, junto com a Udio, em ações que acusam as empresas de uso indevido de gravações protegidas por copyright no treinamento de modelos. A Reuters noticiou em 2024 que as gravadoras pediam indenização de até US$ 150 mil por música supostamente copiada.

Também houve mudanças importantes no front jurídico: a Warner, uma das gravadoras que processava a Suno, fechou acordo de licenciamento com a empresa em 2025, encerrando sua parte no litígio e abrindo caminho para modelos mais licenciados. Segundo a Pitchfork, a parceria inclui compensação para artistas e compositores que optarem por acordos de IA, além da aquisição da Songkick pela Suno.

Ou seja, a Suno está no meio da guerra real: direito autoral, indústria fonográfica, criadores, modelos licenciados, comunidade, profissionalização. É um campo minado, mas é o campo minado certo.

O Google, por enquanto, parece mais preocupado em criar uma suíte elegante.

A Suno está brigando pela linguagem da música com IA. O Google está brigando pela dashboard.

A tese MVAI: ferramenta musical precisa nascer da música, não do PowerPoint

Para quem cria dentro da nova economia da IA audiovisual, o Flow Music é um sinal importante, mas não necessariamente uma ameaça imediata. Ele confirma a tese central da MVAI: música, vídeo, IA e distribuição vão virar uma cadeia única.

O que antes exigia compositor, banda, estúdio, produtor, câmera, locação, equipe de arte, editor, colorista e verba de gravadora agora começa a caber numa pilha de modelos generativos. Isso não elimina direção criativa — pelo contrário, torna direção criativa ainda mais importante.

Só que existe uma diferença entre plataforma e cultura.

A Suno já é usada como instrumento de composição popular. Já virou meme, laboratório, brinquedo, demo, ferramenta de artista independente, máquina de refrão, arma de provocação estética. O Google Flow Music chega com pinta de canivete suíço corporativo: cheio de lâminas, mas ainda sem sangue na ponta.

E música, desculpa, precisa sangrar um pouco.

Veredito: Flow Music pode ser útil, mas Suno ainda é a rua

O Google Flow Music merece atenção. Principalmente por causa da integração com Lyria 3 e Veo. Se o Google conseguir unir música e videoclipe com fluidez real, pode entregar uma ferramenta poderosa para criadores audiovisuais, publicitários, artistas independentes e produtoras IA.

Mas como concorrente direto da Suno, a largada é fraca.

Não porque o Google não tenha tecnologia. Tem até demais. O problema é que o Google parece continuar confundindo criatividade com capacidade computacional. Música não é só gerar áudio. É construir identidade, repertório, catarse, comunidade, vício de uso e desejo de voltar amanhã para fazer outra faixa.

A Suno, mesmo imperfeita, já entendeu isso.

O Google chegou com terno caro, modelo avançado e infraestrutura colossal. A Suno chegou com um refrão.

E na história da música popular, meu querido, quem tem o refrão geralmente vence.

Música

651%: o número que mostra como a IA está refazendo a música eletrônica do zero

Ferramentas de IA para música explodem em receita enquanto a indústria eletrônica global chega ao recorde de US$ 15,1 bilhões

A música eletrônica sempre foi filha da máquina. Nasceu entre sintetizadores, drum machines, samplers, sequenciadores, cabines de DJ, pistas suadas e gente disposta a transformar ruído em futuro. Por isso, quando a inteligência artificial começa a chacoalhar a indústria musical, não é estranho que o primeiro grande terremoto aconteça justamente ali: no território onde tecnologia nunca foi acessório, mas linguagem.

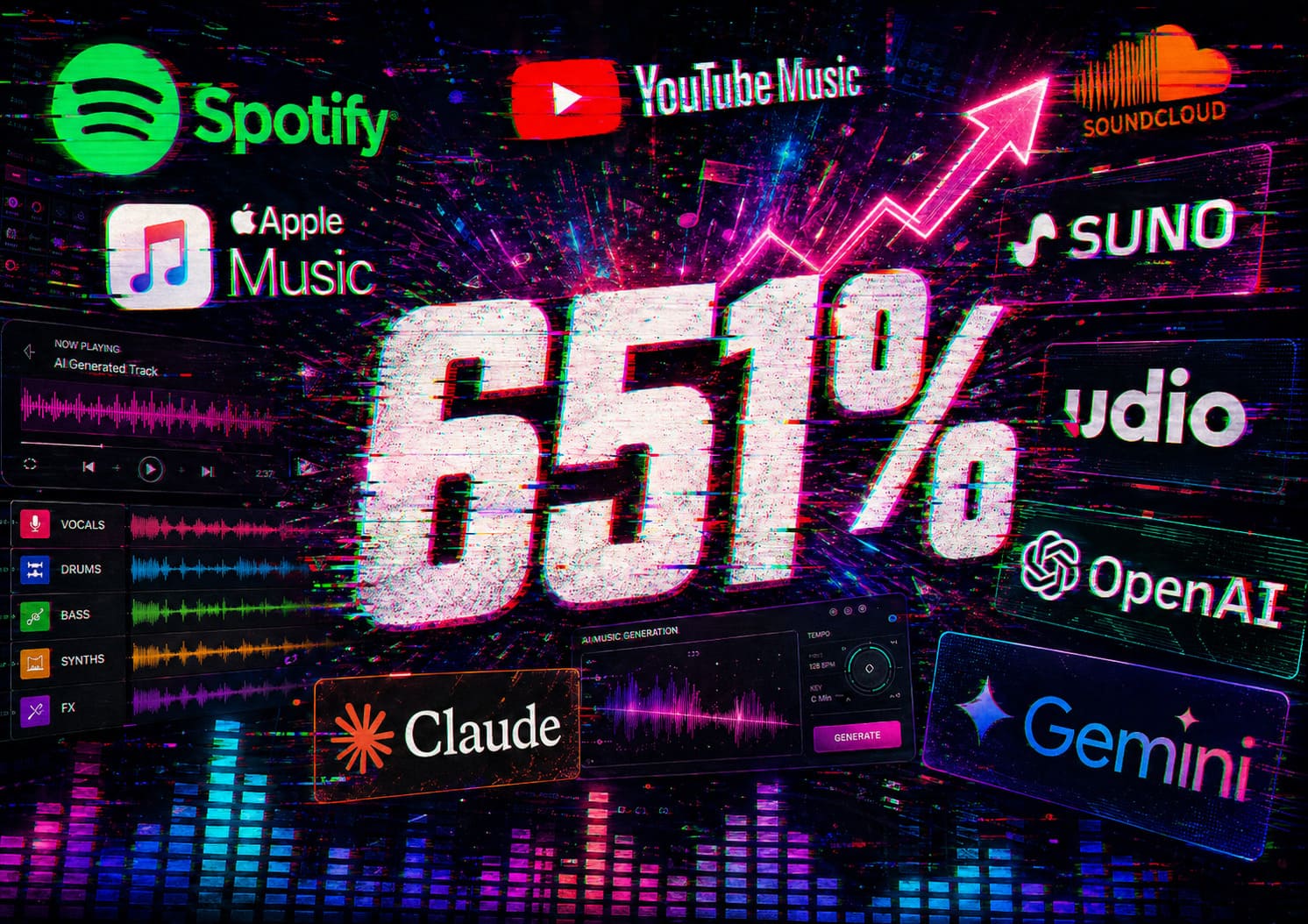

O IMS Electronic Music Business Report 2025/26, apresentado em 22 de abril de 2026, durante a abertura do IMS Ibiza, trouxe um dado daqueles que não pedem licença: a indústria global da música eletrônica chegou ao recorde de US$ 15,1 bilhões, com crescimento de 7% em 2025, acima dos 6% registrados em 2024. O relatório é publicado pelo International Music Summit e compilado por Mark Mulligan, da MIDiA Research.

Mas o número mais incendiário do relatório não está apenas no tamanho da indústria. Está no que ele revela sobre a nova fábrica musical do planeta: as ferramentas de IA generativa e separação de stems tiveram crescimento de 651% em receita entre 2023 e 2025, alcançando US$ 333 milhões em 2025 e chegando a 63 milhões de usuários ativos mensais.

É o tipo de dado que muda a conversa. Não estamos falando mais de “brinquedinho de internet”, “curiosidade de produtor” ou “ferramenta para fazer meme musical”. Estamos falando de uma categoria econômica real, com escala de plataforma, base massiva de usuários e impacto direto na forma como música é criada, remixada, editada, performada e monetizada.

A pista de dança encontrou o prompt

A discussão pública sobre IA na música costuma girar em torno de direitos autorais, clonagem vocal, treinamento de modelos e ameaça aos artistas. Tudo isso é importante — e explosivo. Mas o relatório do IMS aponta para outro centro de gravidade: o maior impacto imediato da IA não está no consumo, mas na criação.

Segundo a cobertura da We Rave You sobre o relatório, as plataformas generativas permitiram que usuários que jamais abririam uma DAW — uma estação de trabalho de áudio digital como Ableton Live, FL Studio, Logic ou Pro Tools — passassem a criar músicas originais a partir de comandos de texto. Ao mesmo tempo, a separação de stems transformou vocais, baterias, baixos e melodias em peças desmontáveis de quase qualquer gravação.

Traduzindo para o chão da pista: a IA está fazendo com a produção musical o que o sampler fez décadas atrás — só que com esteroides, nuvem, prompt e escala global.

Antes, para remixar uma faixa, era preciso ter acesso a stems oficiais, conhecimento técnico ou muita gambiarra. Agora, qualquer DJ, produtor iniciante ou fã com curiosidade consegue separar elementos de uma música, testar versões, reconstruir arranjos, criar mashups, gerar bases, experimentar timbres e transformar ideias em áudio com uma velocidade absurda.

É democratização? É precarização? É pirataria estética? É renascimento criativo? Sim. Tudo ao mesmo tempo. A música eletrônica conhece bem esse caos: foi dele que saíram o house, o techno, o jungle, o garage, o dubstep, o baile funk, o afro house e metade das revoluções dançantes dos últimos 40 anos.

O novo mercado da música eletrônica não vive só de streaming

Outro ponto essencial do IMS Business Report 2026 é que a indústria eletrônica está aprendendo a não depender apenas da lógica do streaming. O relatório mostra que o faturamento global da cena vem de gravações, publishing, DSPs, festivais, clubes, ferramentas para criadores, merchandise, patrocínios e marcas. Segundo a DJ Mag, receitas de DSPs e merchandise estiveram entre os destaques do levantamento.

A Beatportal resume essa virada como uma passagem da “economia do consumo” para uma “economia do fandom”. Ou seja: menos dependência exclusiva de centavos por play e mais força em comunidades, eventos, produtos, experiências, marcas, venda direta e direitos expandidos.

Esse detalhe é crucial para entender por que a IA entra com tanta força. Ferramentas de criação não são apenas softwares. Elas viram infraestrutura de uma nova economia de criadores. Se antes a cadeia era artista → gravadora → distribuidora → rádio/streaming → público, agora existe uma zona intermediária gigantesca formada por produtores de quarto, DJs de TikTok, remixadores, beatmakers, criadores de conteúdo, fãs-produtores e artistas híbridos.

A IA entra exatamente aí: entre a ideia e a música pronta.

A velha eletrônica sempre foi inteligência artificial antes da IA

Para entender por que esse movimento é tão profundo, vale lembrar a própria história da música eletrônica. A EDM é um campo amplo de gêneros percussivos feitos originalmente para clubes, raves e festivais, produzidos para mixagens contínuas por DJs e apresentações ao vivo. Desde os anos 1980 e 1990, com a cultura rave, rádios piratas e cenas underground, a música eletrônica se expandiu em dezenas de subgêneros e ocupou o mainstream global.

Mas a eletrônica nunca foi só “um estilo”. Ela sempre foi um modo de produção. O estúdio virou instrumento. A máquina virou banda. A repetição virou transe. O erro virou textura. O DJ virou autor. O sampler virou memória coletiva.

Por isso, a chegada da IA não cai como um raio em céu azul. Ela chega num território historicamente acostumado a absorver ferramentas e transformá-las em estética. Drum machines como a TR-808, sintetizadores, samplers, controladores, CDJs, plugins, DAWs e plataformas como Splice já haviam redesenhado a criação musical antes. A diferença agora é a escala: a IA não apenas oferece novos sons; ela muda quem pode criar, com que velocidade e a partir de qual ponto de partida.

A pergunta deixa de ser “quem sabe tocar?” e passa a ser “quem sabe dirigir uma ideia sonora?”.

Separar stems virou o novo sampler

A separação de stems talvez seja a parte menos glamourosa da revolução, mas uma das mais importantes. Ela permite isolar voz, bateria, baixo, harmonia e outros elementos de uma música finalizada. Para DJs e produtores, isso significa uma liberdade brutal: acapellas improvisadas, versões alternativas, edits para pista, mashups, remixes não oficiais e reconstruções de repertório.

Na prática, o stem separation transforma qualquer faixa em matéria-prima.

Isso tem implicações artísticas e jurídicas gigantescas. Do ponto de vista criativo, é uma festa. Do ponto de vista dos direitos, é uma granada. Porque a mesma tecnologia que permite ao produtor independente estudar arranjos e criar versões inovadoras também pode abrir caminho para usos não autorizados, exploração de catálogos e colagens que desafiam os modelos tradicionais de licenciamento.

Mas aqui existe um ponto histórico: a música eletrônica sempre viveu de apropriação, recorte, loop e ressignificação. A IA apenas aumenta a velocidade e a resolução desse processo.

O dado dos 63 milhões de usuários muda o jogo

O número de 63 milhões de usuários ativos mensais em ferramentas de IA musical é talvez tão importante quanto a receita. Segundo a We Rave You, essa escala coloca as ferramentas de IA musical no território de serviços de streaming de médio porte, embora com receita por usuário ainda baixa em comparação às assinaturas musicais.

Isso sugere duas coisas.

A primeira: existe demanda real. Muita gente quer criar música, mesmo sem formação musical tradicional. A barreira técnica sempre foi uma espécie de porteiro invisível. A IA não elimina talento, repertório ou direção artística, mas derruba parte do muro operacional.

A segunda: esse mercado ainda pode crescer muito em monetização. Se milhões de usuários já estão usando ferramentas de IA musical, mas a receita média ainda é pequena, há espaço para planos premium, bibliotecas, licenciamento, plugins, distribuição integrada, marketplaces de vozes, packs de stems, masterização automática, videoclipes gerados por IA e ferramentas de performance ao vivo.

Ou seja: a música criada com IA não é só uma categoria estética. É uma cadeia produtiva nascendo.

A indústria eletrônica chega ao recorde, mas muda por dentro

O IMS 2026 mostra uma cena eletrônica global em crescimento, mas também em mutação. A indústria chegou aos US$ 15,1 bilhões depois de valer US$ 14,2 bilhões em 2024. Em Ibiza, a receita de ingressos de clubes atingiu €160 milhões em 2025, contra €150 milhões no ano anterior, mesmo com queda no número médio de eventos por venue.

Esse é um retrato curioso: menos volume, mais eficiência. Menos evento por evento, mais rendimento por programação. É a cena eletrônica entrando numa fase mais madura, profissionalizada e cara — ao mesmo tempo em que a criação musical fica mais barata, mais acessível e mais caótica.

De um lado, clubes, festivais, catálogos, marcas e patrocínios se sofisticam. Do outro, qualquer adolescente com prompt, fone e celular pode gerar uma faixa, separar stems, montar um edit e jogar no TikTok.

É uma indústria bilionária encontrando uma fábrica criativa descentralizada. Bonito? Perigoso? Inevitável.

Global South, Afro House e a pista fora do eixo EUA-Europa

Outro dado relevante do relatório é o avanço do chamado Sul Global. A Beatportal destaca que mercados com grandes populações passaram a impulsionar boa parte dos novos assinantes e ouvintes. A Indonésia, por exemplo, registrou aumento de 77% em ouvintes de música eletrônica no Spotify em 2025.

A DJ Mag também destaca que o relatório aponta a presença crescente do Sul Global no crescimento da indústria.

Isso conversa diretamente com o crescimento de gêneros e cenas que já não cabem no mapa tradicional da eletrônica europeia. Afro house, amapiano, funk brasileiro, dembow, guaracha, baile, techno latino, cenas africanas e asiáticas entram no jogo com outra gramática rítmica, outro corpo, outra relação com comunidade e festa.

O relatório também observa que o Afro House saltou da 10ª posição em buscas no Splice em 2023 para a 2ª em 2025, com aumento de 82% nas buscas.

Aqui a IA pode ter um papel ambíguo. Ela pode amplificar cenas periféricas, baratear produção, facilitar circulação e permitir que artistas do Sul Global criem com ferramentas antes restritas por custo. Mas também pode pasteurizar tudo, transformar cultura viva em preset global e acelerar a apropriação estética sem contexto.

A diferença entre revolução e extrativismo vai depender de quem controla as ferramentas, os catálogos, os dados, as plataformas e a remuneração.

AI slop ou nova vanguarda?

A própria Beatportal usa uma expressão importante ao falar do futuro da cena: a indústria precisa aproveitar ferramentas de IA sem cair no “AI slop”, aquela avalanche de conteúdo genérico, descartável, feito para ocupar feed e plataforma sem alma, sem risco e sem mundo.

Esse é o ponto nervoso.

A IA pode permitir que milhares de pessoas descubram a criação musical. Mas também pode entupir o ecossistema com faixas medianas, playlists sintéticas, artistas inexistentes e uma estética de algoritmo treinado para agradar todo mundo sem emocionar ninguém.

Na música eletrônica, isso é ainda mais delicado. Porque a pista não perdoa. Um beat pode ser tecnicamente perfeito e emocionalmente morto. Pode ter masterização impecável e zero corpo. Pode soar “profissional” e não levantar uma sobrancelha às três da manhã.

A grande questão não é se a IA vai criar música. Ela já está criando. A questão é quem vai transformar essa criação em linguagem, cena, estética, comunidade e presença.

O produtor vira diretor criativo

O crescimento das ferramentas de IA musical aponta para uma mudança de função. O produtor deixa de ser apenas alguém que domina software, síntese, mixagem e arranjo. Cada vez mais, ele vira um diretor criativo de sistemas.

Isso significa saber pedir, selecionar, editar, combinar, rejeitar, lapidar e contextualizar. A criação passa a ser menos linear e mais curatorial. Em vez de construir tudo nota por nota, muitos criadores vão operar como diretores de fluxo: geram possibilidades, escolhem caminhos, manipulam resultados e dão acabamento humano.

É parecido com o que já acontece no audiovisual com ferramentas de geração de imagem e vídeo. A autoria não desaparece, mas muda de lugar. O gesto artístico passa a estar na concepção, na direção, no gosto, no repertório, na montagem, na assinatura e na capacidade de dizer “isso presta” ou “isso é só lixo brilhante”.

Na música, esse filtro será cada vez mais valioso.

O Brasil deveria prestar atenção

Para o Brasil, esse relatório é mais do que uma curiosidade internacional. É um sinal estratégico.

O país tem uma das culturas musicais mais fortes do mundo, uma cena eletrônica diversa, um funk em permanente mutação tecnológica, produtores de quarto altamente inventivos e uma tradição absurda de gambiarra criativa. Se a barreira de entrada cai, o Brasil pode ganhar uma nova geração de criadores capazes de exportar som, estética e linguagem.

Mas há um problema: as ferramentas são dolarizadas. A criatividade é brasileira, mas a infraestrutura é importada. Isso cria uma tensão central para o futuro da música feita com IA no país. Quem não tiver acesso a assinaturas, créditos, plugins, modelos e distribuição fica novamente na periferia da revolução.

Por outro lado, se artistas, selos, coletivos, escolas, produtoras e plataformas brasileiras entenderem o momento, a IA pode virar uma aliada poderosa. Não para substituir a música brasileira, mas para multiplicar sua capacidade de produção, experimentação e presença global.

A música eletrônica brasileira — do techno ao funk, do bass ao experimental, do pop periférico à IA generativa — tem tudo para disputar esse novo território. Mas precisa entrar agora, antes que a nova indústria seja desenhada apenas por empresas do Norte Global.

Conclusão: a próxima pista será feita por humanos, máquinas e prompts

O IMS Business Report 2026 não está dizendo apenas que a música eletrônica vale US$ 15,1 bilhões. Está dizendo que a infraestrutura criativa da música está mudando. A explosão de 651% nas receitas de ferramentas de IA musical é o alarme mais claro até agora: a criação sonora entrou numa nova fase.

A música eletrônica, que sempre foi o laboratório pop da tecnologia, aparece novamente na linha de frente. A pista de dança agora conversa com o prompt. O DJ conversa com stems separados por IA. O produtor conversa com modelos generativos. O fã começa a virar criador. O software vira parceiro. O catálogo vira material desmontável. A música vira processo contínuo.

Mas a pergunta que fica é a mais antiga de todas: quem tem algo a dizer?

Porque ferramenta, por si só, não faz cena. Modelo nenhum cria cultura sozinho. A IA pode gerar som, mas ainda não sabe viver uma madrugada, perder um amor, suar numa pista, tomar enquadro voltando pra casa, atravessar uma cidade, inventar uma comunidade, desafiar um sistema ou transformar precariedade em batida.

A revolução está aberta. E a música eletrônica, mais uma vez, está dançando antes de todo mundo entender a coreografia.

Música

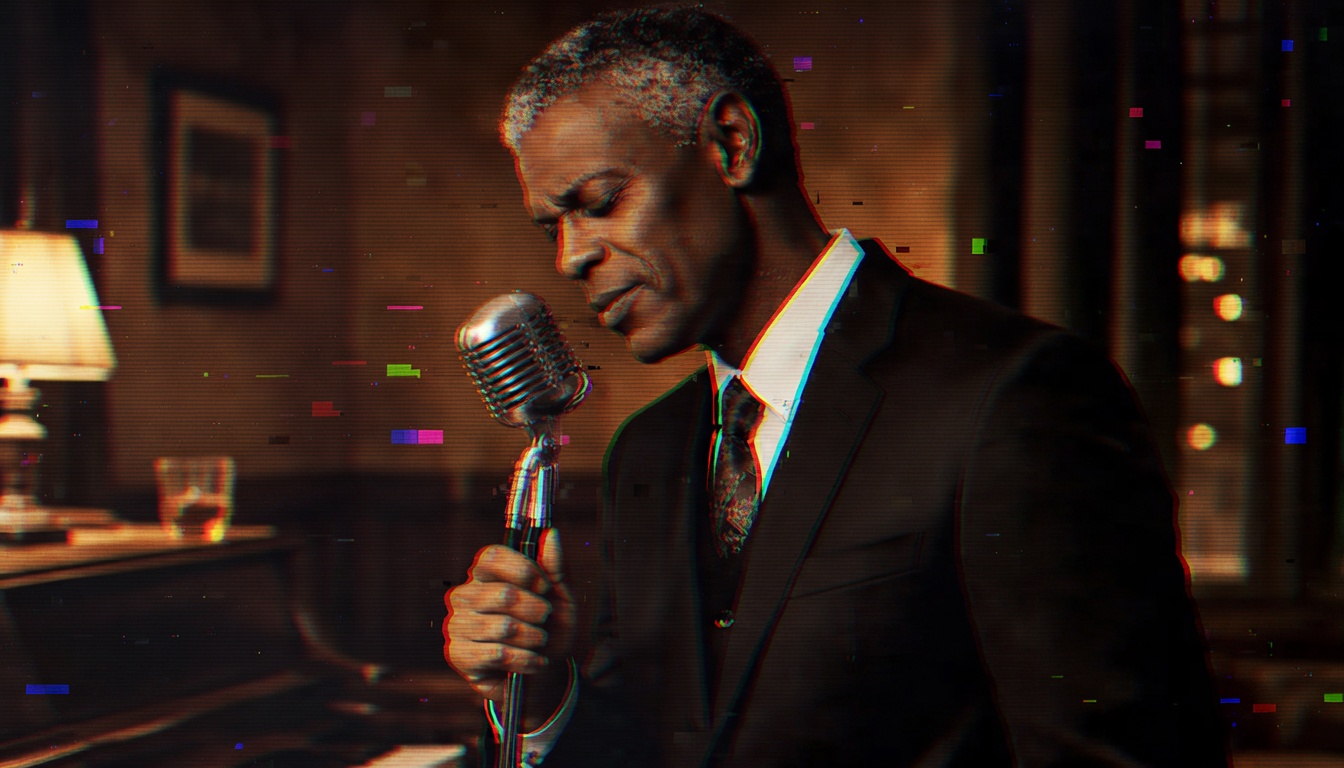

Quem é Eddie Dalton? A ascensão do bluesman artificial que bagunçou o iTunes

Eddie Dalton chegou às paradas com a cara de um veterano do soul e do blues: grisalho, expressão cansada, microfone vintage, voz grave e repertório moldado para soar como herdeiro tardio de Otis Redding, B.B. King e Ray Charles. Só que Eddie Dalton não existe. O personagem é uma criação de IA associada a Dallas Ray Little, produtor e criador de conteúdo da Carolina do Sul ligado à Crunchy Records, operação que vem lançando músicas e vídeos com artistas fictícios. A história ganhou força após reportagens mostrarem que Dalton ocupou múltiplas posições no iTunes e apareceu também em rankings oficiais de download no Reino Unido.

Nas plataformas, o projeto foi montado para parecer um artista completo, não apenas uma faixa isolada gerada por ferramenta. O canal principal de Eddie Dalton no YouTube reúne dezenas de vídeos e, no momento da consulta, aparecia com dezenas de milhares de inscritos e vídeos com centenas de milhares — em alguns casos, milhões — de visualizações. Faixas como “Another Day Old”, “Running To You” e “Cheap Red Wine” se tornaram a linha de frente dessa persona musical, enquanto o álbum The Years Between também passou a circular nas lojas digitais.

O ponto mais importante, porém, não é apenas que Eddie Dalton seja artificial. É como ele cresceu. Nos charts do Reino Unido, por exemplo, “Another Day Old” chegou ao nº 2 no ranking oficial de downloads, “Running To You” ao nº 3, e outras faixas também entraram na mesma lista. Já The Years Between apareceu no ranking oficial de album downloads com pico em nº 4 e no chart de album sales com pico em nº 47. Isso mostra que o fenômeno não ficou restrito a prints de rede social: ele de fato encostou em rankings oficiais de venda digital.

A apresentação do projeto, no entanto, segue numa zona cinzenta. Dallas Little afirmou que seus vídeos em redes sociais são claramente identificados como gerados por IA e disse que escreve as músicas. Mas a própria cobertura da Newsweek observou que nem sempre essa rotulagem aparece de forma igualmente clara em todos os ambientes, especialmente quando o público encontra a obra já empacotada como artista pronto, com capa, discografia e lyric videos. Em termos editoriais, esse detalhe importa muito: uma coisa é um experimento de IA assumido como experimento; outra é uma persona fabricada para circular como artista “normal” até o momento em que a imprensa revela a origem.

A pergunta central então vira outra: houve farm de cliques ou compra artificial de números? Pela apuração pública disponível até agora, a resposta honesta é: não dá para afirmar.

Não encontramos evidência aberta, auditável e conclusiva de bot farm, click farm ou campanha de fraude comprovada associada ao projeto. O que existe são reportagens e comentários de observadores do mercado levantando essa hipótese por causa da velocidade do crescimento, da discrepância entre presença cultural e performance em chart, e da facilidade com que rankings de download podem ser distorcidos por ações relativamente pequenas e coordenadas.

E é justamente aí que o caso fica interessante. O iTunes não mede o mesmo tipo de sucesso que Spotify, YouTube ou rádio. Rankings de download refletem compras unitárias, e esse ecossistema encolheu tanto que movimentos menores podem gerar impacto desproporcional. Esse problema já vinha sendo apontado antes: em 2024, a Consequence explicou que esforços organizados relativamente pequenos já conseguem deslocar músicas no iTunes para posições que parecem maiores do que sua presença real no consumo geral. Em paralelo, a própria estrutura do mercado hoje é amplamente dominada por streaming: a RIAA informou que o streaming respondeu por 82% da receita da música gravada nos EUA em 2025. Ou seja, um estouro em download continua chamando atenção, mas já não equivale automaticamente a penetração massiva de público.

Os números reportados em torno de Eddie Dalton reforçam essa desconfiança estrutural. Segundo dados atribuídos à Luminate e reproduzidos por veículos e colunistas, a operação teria alcançado algo na casa de 6.900 vendas de faixas e cerca de 525 mil streams no período em que o caso explodiu — números relevantes para um projeto recém-lançado, mas ainda assim modestos frente ao barulho simbólico de dominar tantas posições no iTunes. Isso não prova fraude; prova outra coisa: que o sistema de charts de download parece vulnerável a campanhas muito eficientes, nichadas ou oportunistas, inclusive quando operadas por uma única máquina de conteúdo.

Também há alguns sinais públicos que alimentam a suspeita sem fecharem o diagnóstico. Um deles é a relação entre volume de catálogo, velocidade de lançamento e alta concentração de posições em chart num intervalo muito curto. Outro é a coexistência de vídeos “oficiais”, uploads automáticos de distribuidora e múltiplos recortes em shorts, o que amplia presença algorítmica. Some-se a isso a estética extremamente calibrada do projeto — nostalgia visual, voz “envelhecida”, letras seguras, persona coerente — e Eddie Dalton deixa de parecer apenas uma música viral: ele passa a parecer uma engenharia de catálogo pronta para explorar brechas de distribuição e descoberta. Isso é uma inferência editorial baseada no padrão de publicação observado, não uma prova de fraude.

Se houve click farm humana, compra de views, bots ou manipulação direta, isso exigiria acesso a dados que o público simplesmente não tem: retenção de audiência, origem geográfica detalhada dos plays, curva temporal de aquisição de inscritos, relatórios de campanha, dados internos de distribuição e eventuais auditorias das plataformas. Sem isso, o máximo que se pode dizer com rigor é que o caso é estranho o suficiente para merecer investigação, mas ainda insuficiente para acusação categórica.

No fim, Eddie Dalton é menos uma prova de “golpe” do que um teste de estresse para o mercado. Ele mostra que já é possível lançar um cantor fictício com aparência de artista consolidado, converter curiosidade em compra digital e capturar legitimidade de chart antes mesmo de o público entender o que está consumindo. Se houve trapaça, ela ainda não foi demonstrada publicamente. Mas mesmo que não tenha havido, o episódio já expôs uma fragilidade real: na era da IA, parecer popular pode ser quase tão valioso quanto ser popular.

-

Tecnologia & IA1 semana atrás

Tecnologia & IA1 semana atrásIA em 2026: os gráficos que revelam o verdadeiro estado da revolução tecnológica

-

Tecnologia & IA1 semana atrás

Tecnologia & IA1 semana atrásAnthropic aposta em IA mais precisa e poderosa com Opus 4.7

-

Cinema1 semana atrás

Cinema1 semana atrás“Bitcoin: Killing Satoshi” pode inaugurar nova era do cinema por inteligência artificial

-

Cinema6 dias atrás

Cinema6 dias atrásHiggsfield quer transformar influenciadores em estrelas de séries feitas por IA

-

Videoclipe5 dias atrás

Videoclipe5 dias atrásK-pop encontra cinema de IA: XODIAC leva videoclipe “Alibi” para festival em Cannes

-

Cinema3 dias atrás

Cinema3 dias atrásWAIFF x Cannes: tradição e inteligência artificial duelam no coração do cinema mundial

-

Tecnologia & IA5 dias atrás

Tecnologia & IA5 dias atrásAI Index 2026: as 12 conclusões que revelam o tamanho real da revolução da IA

-

Música3 dias atrás

Música3 dias atrás651%: o número que mostra como a IA está refazendo a música eletrônica do zero